苹果iPhone 16系列备货量增至9500万台,展现市场信心

苹果公司最近一个月两次增加iPhone16系列手机的备货量,相关备货量已增至9500万部,显示出对新产品销售的信心。内部人士表示,苹果公司推出的AppleInt...

2025-01-22

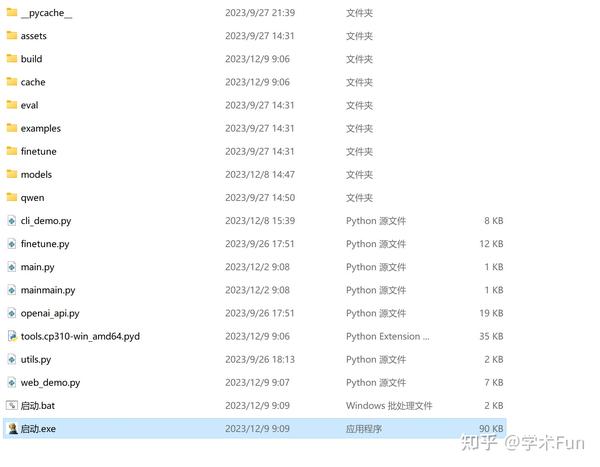

阿里巴巴最近开源了其最新的视觉多模态模型Qwen2-VL,根据测试数据,这款72B模型在多数指标上超越了OpenAI的GPT-4o和Anthropic的Claude3.5-Sonnet等知名闭源模型,成为当前最强大的多模态模型之一,Qwen2-VL支持中文、英文、日文、韩文等多种语言,并允许在Apache2.0协议下进行商业化使用。

想象一下,如果你有一个可以同时理解和生成图像及文字的智能助手,那将是多么神奇的体验!这正是Qwen2-VL所擅长的领域,无论是复杂的图像识别任务还是自然语言处理问题,它都能游刃有余地应对。

在医疗领域,医生可以通过上传X光片或MRI扫描图来获取初步诊断建议;而在教育行业,教师可以利用该技术自动批改作业或者提供个性化学习材料,对于创意工作者来说,他们也可以借助这一工具快速生成设计方案草图或是撰写故事大纲。

然而值得注意的是,尽管Qwen2-VL展现出了令人印象深刻的能力,但它仍然处于不断迭代和完善的过程中,未来随着更多应用场景的出现和技术的进步,我们有理由相信这个平台将会变得更加强大和实用。

本文由站长之家合作伙伴自媒体作者“AIGC开放社区公众号”授权发布于站长之家平台,由于内容发布时间较长,为确保信息及时性和准确性,请访问原文链接以获取完整详情。

(查看更多)

相关问题:

- Qwen2-VL主要应用于哪些领域?

- A: Qwen2-VL可用于医疗辅助诊断、教育自动化评估、创意产业设计等多个方面。

- 与其他同类模型相比,Qwen2-VL有哪些优势?

- A: 它不仅支持多种语言,而且在多项性能指标上超过了GPT-4o和Claude3.5-Sonnet等领先产品。

- 如何获得关于Qwen2-VL更详细的信息?

- A: 可以通过访问原文链接来获取完整的技术文档和使用指南。

版权声明:本文内容由互联网用户自发贡献,本站不拥有所有权,不承担相关法律责任。如果发现本站有涉嫌抄袭的内容,欢迎发送邮件至 dousc@qq.com举报,并提供相关证据,一经查实,本站将立刻删除涉嫌侵权内容。

当前页面链接:https://lawala.cn/post/13712.html

相关文章

苹果公司最近一个月两次增加iPhone16系列手机的备货量,相关备货量已增至9500万部,显示出对新产品销售的信心。内部人士表示,苹果公司推出的AppleInt...

2025-01-22

曾经叱咤风云的美国航天,如今各种不顺利,宇航员在空间站回不来,重返月球一再推迟,对木卫二的旗舰探测任务欧罗巴”也遇到了大麻烦:晶体管太脆弱,扛不住宇宙辐射。欧罗...

2025-01-22

「因果推理」绝对是当前GenAI热潮下的小众领域,但是它有一个大佬级的坚定支持者——YannLeCun。他在推特上的日常操作之一,就是炮轰Sora等生成模型,并...

2025-01-22

【新智元导读】84岁的美国老人DorothyElicati在失去结婚65年的丈夫后,每天醒来唯一做的事就是哭泣,直到一个AI机器人的出现。美国会每年花费70万美...

2025-01-22

2024年,头部主播集体瞄准了短剧赛道。最新涌入的玩家是薇娅夫妇。直播带货之后,头部主播们寄希望于通过短剧实现业绩增长,或许难度系数比直播带货本身还要大。...

2025-01-22

国内风头最盛的AI视频团队是哪家?毫无疑问,快手可灵。发布一个月,体验用户超30万,生成700万条短视频,开放网页Web端。要不大家老说呢,技术人才们总是喜欢蛰...

2025-01-22

发表评论